Sedan GPT-3 kom till har det kommit en mängd nya företag som kämpar om användarnas uppmärksamhet genom att sälja AI copywriting-tjänster för olika format.

E-post, blog inlägg, landningssidor, annonser copy, försäljningskommunikation...

Minns du när det mesta av översättnings- och korrekturläsningsarbetet fortfarande gjordes av människor?

Sedan kom DeepL, Google Translate och Grammarly.

Demokratisera och påskynda läs- och skrivkunnighet och språk för alla.

Gissa vad?

Det som hände där händer nu med textframställningen.

Källskiktet i hela värdekedjan.

Låt oss diskutera vad som händer med AI copywriting, varför GPT-3 bara är början och hur de flesta av dessa AI copywriting-verktyg inte gör mycket mer än att bygga ett vackert ansikte ovanpå samma kärna.

Jarvis, Copy AI , CopySmith, CopyShark, Writesonic, Anyword...

De kom hit, såg GPT-3 och försöker nu vinna dig som en potentiell användare.

Vissa av AI :s verktyg för copywriting har vuxit otroligt snabbt, byggt upp starka intäktsbanor och tagit emot pengar från fina investerare.

De lovar ofta för mycket med hundratals templates som inte riktigt håller vad de lovade och som när de kokas ner är likadana och inte har någon möjlighet att påverka och förbättra sin textkvalitet.

De är alla beroende av...

GPT-3 från OpenAI.

Den kan mycket, är ett verkligt generalistiskt kraftpaket inom artificiell intelligens och en fyrtorn för många nyfikna hjärnor som nu har strömmat till området för generering av naturliga språk.

Men GPT-3 är bara början på en teknikgren som utvecklas otroligt snabbt.

Plötsligt fanns GPT-3 och faran blev en möjlighet. OpenAI:s historia

Jag ska ge dig en kort teknisk introduktion. Låt mig berätta mer om innebörden av dessa till synes hemlighetsfulla bokstäver.

G P T - 3 står för Generative Pre-trained Transformer v3.

Låt mig gå igenom den - ord för ord.

Att börja enkelt med "generativ" betyder att AI -modellen är avsedd att skapa.

Med "transformer" menar vi inte Autoboter i storlek av ett trevåningshus som vi känner till från filmerna.

Transformers är en relativt ny utveckling inom djupinlärning och artificiell intelligens.

En teknik som ger en maskin möjlighet att lära sig mönstren i det mänskliga språket och fortsätta det genom att skapa meningar ord för ord.

En ensam transformatormodell är som en nyfödd som inte kan göra mycket förrän den lär sig av sina föräldrar.

Transformers lär sig genom att läsa miljarder exempel för att bli kreativa.

Det är därför den kallas "förtränad" på en stor mängd mänskligt språk.

Vi talar om biljoner ord.

Jag kommer också att tala om modeller här och där.

Det är inte fråga om högmodigt mode här, så försök att se modellen som en ögonblicksbild av något.

Inklusive alla erfarenheter, lärdomar och utvecklingar som den genomgått.

Tänk på hur du vaknade upp i morse, detta enda ögonblick som återspeglar och inkluderar hela ditt liv fullt av erfarenheter och lärande som har gjort dig till den person du är idag.

Föreställ dig att du tar en ögonblicksbild av det här ögonblicket med alla tidigare händelser som påverkat det. Detta är en modell som är förtränad på dina erfarenheter.

Låt mig veta om detta gjorde GPT-3-modellen lite mer begriplig för dig i kommentarerna eller i en DM.

Vi är TextCortex en AI startup som tar bort 80 % av ditt skrivarbete.

OpenAI:s historia

Varför är OpenAI viktigt i detta sammanhang?

De var den fyr som kunde samla det avgörande intresset för området.

Vi lockar människor från alla bakgrunder in i rummet, från nyfikna akademiker, seriösa företag, kreativa entreprenörer till enskilda individer som alla vill vara med när transformatorisk teknik skriver historia.

Låt oss börja denna berättelse med dem som har skapat GPT-3.

Slutet av 2015 - Historien börjar, som så många andra innovativa utvecklingar vi ser idag, med självaste teknikern Elon Musk.

Tillsammans med Sam Altman och några andra investerarkompisar lovade de hela 1 miljard dollar för att bygga upp en ideell organisation som skulle samarbeta fritt med forskarsamhället och leda den etiska utvecklingen av AI.

2019 var ett verkligt händelserikt år för OpenAI.

Efter att Elon Musk lämnat organisationenM icrosoft engagerade sig med ytterligare en miljard USD för att omvandla företaget till en kommersiellt driven vinstdrivande organisation.

Medan OpenAI förberedde sig för marknaden började en av deras modeller att slå igenom - den var då för farlig för att släppas ut i världen.

Sidanote: De faror som nämns ovan var en av anledningarna till att jag flyttade till rymden medan jag fortfarande studerade maskininlärning på universitetet.

År 2020 släppte de GPT-3 till världen.

En AI -modell som är nästan 116 gånger större än sin föregångare med 175 miljarder parametrar*.

Till en början var det bara några få utvalda institutioner som fick experimentera med GPT-3, tills de nyligen öppnade upp GPT-3 för alla som var villiga att betala en dyrbar summa för dess kapacitet.

- Tänk på parametrar som storleken på hjärnan på AI som kompletterar och hjälper dig.

Framväxten av AI copywriting

GPT-3 har motiverat många produktutvecklare att skapa ett trevligt användargränssnitt ovanpå GPT-3. Jag nämnde bara några av dem i början.

Vi ser dock varje vecka nya lanseringar av den alltid lika identiska produkten.

Efter att ha sett det 40:e verktyget slutade jag samla in information om dem i min kunskapsbank...

Jag såg några av dem som hävdade att de skiljer sig från andra genom att vara bättre på att "kommunicera med API om GPT-3".

Vad betyder det? Är det en faktisk differentieringspunkt?

API är en förkortning för ett gränssnitt för tillämpningsprogrammering.

Det låter komplicerat, men minns du hur de stora oraklen i filmer alltid hade en portvakt som talade för dem?

API är en sådan sak för datorer.

Alla dessa AI copywritingföretag vallfärdar till GPT-3:s portvakt för att skicka sina användares önskemål och få svar på dem.

Tillbaka till frågan om att vara den bästa kommunikatören till portvakten API i GPT-3.

Även om kommunikationen är viktig påverkar den inte oraklets process när det skapas.

Endast OpenAI kan förbättra den artificiella intelligens som skapas för dig.

GPT-3 är dock inte längre det enda orakel som finns i blocket.

Med det ökade intresset finns det en mängd olika orakel tillgängliga och på TextCortex är det vårt dagliga bröd att träna dem på våra egna data för att de ska bli så bra som möjligt för sina respektive syften.

4 saker att vara försiktig med när du använder skrivverktyg för GPT-3

Som jag sa har vi sett dessa AI -verktyg för copywriting dyka upp som svampar på ett regnigt skogsgolv.

De flesta av dem har en enda motivation - att tjäna snabba pengar.

Det blir ett problem när det gäller stabiliteten hos företaget bakom programvaran.

Vi gjorde några uppskattningar och tog ett exempel på våra kraftfulla användare: deras verksamhet skulle kosta omkring 100 USD per månad för en enskild användare.

Jag beklagar att de som har påbörjat livstidsavtal för att sedan inse att GPT-3 inte är gratis.

Det är tråkigt för de kunder som köpte dem och som nu står framför den stängda dörren med en programvara som inte svarar tillbaka.

Även stora företag som AI companions som Replika AI med sina 7 miljoner användare har gått ifrån GPT-3 på grund av begränsningen att inte kunna påverka kvaliteten samtidigt som de betalar en hög driftskostnad för att vara låsta i beroenden.

1. Hoppa inte på det billigaste (livstids)erbjudandet

Som med många andra saker i livet är det dyrt att köpa billigt.

Det gäller även livstidsavtal.

Jag har sett många användare vända sig till oss för att programvaran som de brukade arbeta med vid ett tillfälle antingen stängde ner kundsupport eller inte längre fungerade i sig själv eftersom den hade en grundläggande funktionsbrist.

Var försiktig... med att betala snabba pengar till någon som har dollartecken i ögonen.

2. Fall inte för knepet med antalet templates

Många annonser på templates är bara platshållare för att du ska få en uppfattning om vad du kan vara intresserad av.

Detta är ett vanligt klagomål som vi observerar. En dålig "instruktion för skapelserelevans" eller ett ständigt upprepat skapelsemönster.

Vi frågar aktivt våra användare vad de vill ha i nära samtal inom våra communities.

När vi ser ett tillräckligt stort intresse för ett format gräver vi djupt, samlar in data, utbildar våra egna AI transformatormodeller och erbjuder våra samhällen något hållbart.

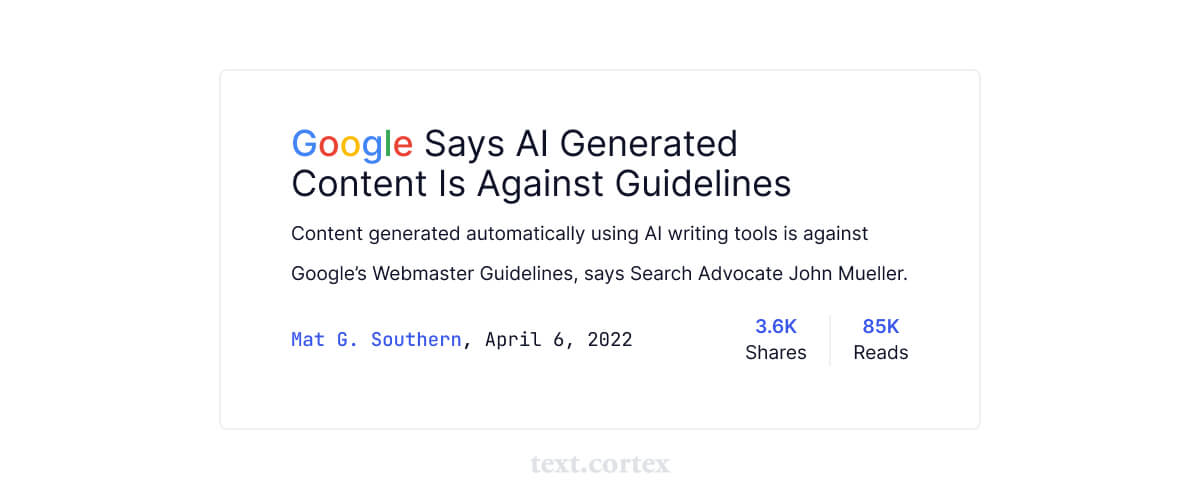

3. När alla använder samma sak kan det skada din ranking.

Alla dessa regelbaserade programvaror som påstår sig vara AI men som i slutändan bara trycker och vrider på dina inmatningar genom en process som är skräddarsydd av en cookie-cutter, håller på att drabbas.

Även om modern AI -teknik som GPT-3 känns otroligt kreativ och naturlig ger det en känsla av säkerhet att det skulle vara svårt att upptäcka deras skapelser.

Men om för många människor använder ett enda mönster för att skapa det kan det bli omvänt konstruerat.

Vi ser leverantörer som erbjuder GPT-3 där du ska skriva 10 000 Blog -artiklar per månad.

De dåliga aktörerna kommer bara att spåra fler spår för att komma fram till en lösning.

För närvarande tror vi att ett mått på relevans genom innehåll (RTC) kan användas för att upptäcka användningen av AI genererat innehåll.

Låt mig ge er en jämförbar situation på marknaden för mobiltelefoner.

Om du skulle erbjuda en tjänst, bygga en app eller attackera ett system, vilket skulle du välja?

Apples iOS med ca 27,5 % eller Androids 71 % globala andel av mobila operativsystem?

Tänk därför på vad Googles första mål kommer att vara när du tar itu med AI-genererat innehåll.

Det är till din fördel att använda målinriktade modeller som är experter på sitt område.

Dessutom bör du sträva efter så stor anpassningsbarhet som möjligt. Vi erbjuder dig till exempel att använda olika kreativitetsmotorer.

4. Instabilitet när infrastrukturen uppdateras.

Dessa stora språkmodeller utvecklas kontinuerligt.

Varje uppdatering och utbildning av den underliggande infrastrukturen påverkar textkvaliteten.

Eftersom de flesta av AI :s verktyg för copywriting är beroende av de många variationerna av GPT-3, stör en förändring i deras infrastruktur kvaliteten.

Det tar tid innan de har hittat "sin kommunikation med oraklet igen". ;)

Varför GPT-3 bara är början på generering av naturliga språk och hur vi gör saker och ting annorlunda på TextCortex

Jag har redan spoilat det ganska många gånger och du kan gissa mitt svar på frågan om vi uppnådde Olymp för generering av naturliga språk med GPT-3?

Nej, det har vi inte.

Utan tvekan säger jag det igen: GPT-3 var det djärva steg som fick människor, akademiker, företag och regeringar att börja arbeta med området.

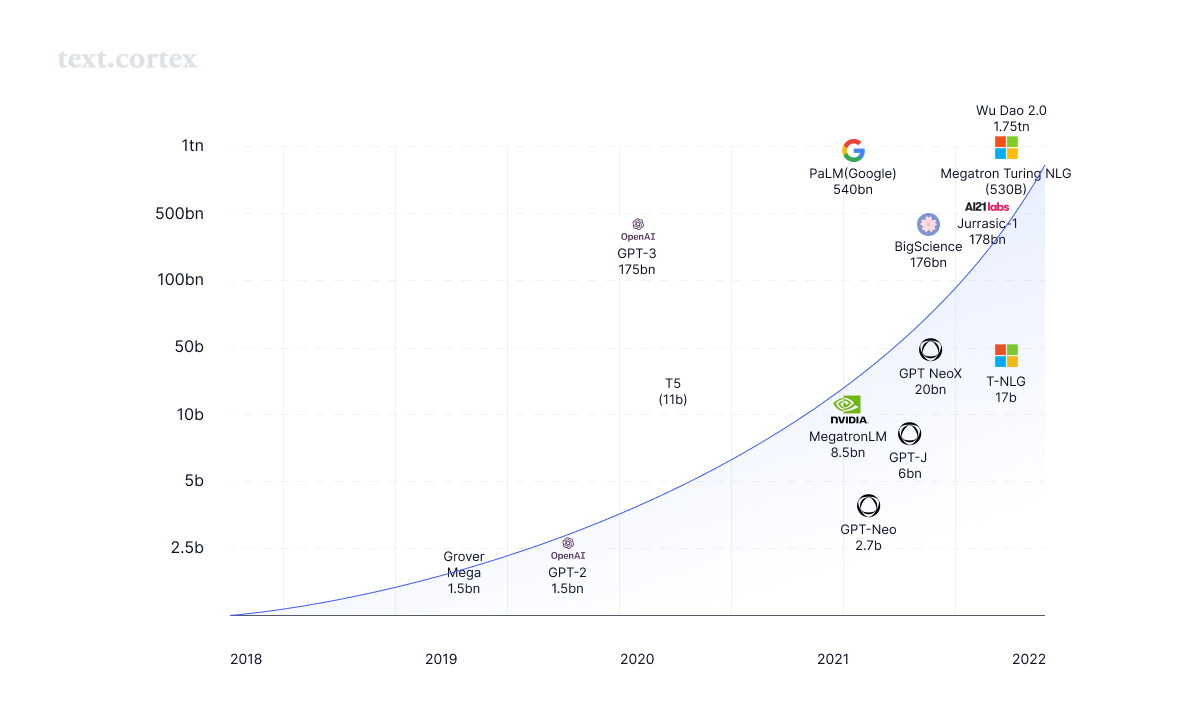

Men det är ändå början på en ny era. För närvarande ser vi en kapprustning när det gäller att skapa artificiell intelligens med allt fler parametrar och allt större hjärnor.

För att återgå till min berättelse om Transformers (filmen) Microsofts Megatron-Turing-modell.

En modell med en hjärna som är tre gånger så stor som GPT-3.

Att använda dess 530 miljarder parametrar för att skriva en beskrivning av din produkt eller en artikel på blog är som att bygga ett kolkraftverk för att ladda din smartphone.

Det slutar inte där.

Ryktena säger att GPT-4 kommer att ingå i triljonparametrarna.

Google meddelade att man redan har uppnått en modell på flera triljoner.

Den kinesiska Wu Dao-modellen finns också där.

Betyder det att de är 10 gånger bättre än GPT-3?

Är det så att en större parameterstorlek leder till bättre skapande?

Kommer stor makt med stort ansvar?

En sak är säker: med stora parameterstorlekar följer också en stor energiförbrukning.

Att bygga, träna och använda så stora språkmodeller är en katastrof för miljön.

Minns du hur jag talade om "förtränade" modeller tidigare? Det hjälper inte att skapa en hjärna som är större än den mängd som den kan lära sig från. Det smartaste småbarnet är begränsat till att lära sig vad det kan observera från sin omgivning.

Vi har stor respekt för de stora aktörerna inom NLG-området, från OpenAI till DeepMind, EleutherAI och AI21 Labs.

Alla lägger enorma ansträngningar och resurser på att föra mänskligheten ett steg framåt.

Vi vill ansluta oss till dem i deras strävan och föraktar dem som törstar efter snabba pengar på grund av deras arbete.

På TextCortex gillar vi att göra det hårda arbetet.

För inget varaktigt och konkurrenskraftigt värde byggs upp genom att ta genvägen när det gäller själva kärnan.

Skapelsens kvalitet.

Och även om GPT-3 är en generalist, en riktig allkonstnär, är den redan enormt stor för användningsområdet AI copywriting.

Precis som mänskligheten har gått från generalisering till specialisering för att utvecklas och nå dit vi är idag.

Detta kommer också att gälla för generering av naturliga språk.

Det är därför vi på TextCortex inte utvecklar en modell som passar alla. Vi bygger små målinriktade modeller som upprättar och organiserar ett nätverk.

Eftersom en "enhetlig storlek passar alla" helt enkelt inte passar alla.

Istället för en massiv modell med triljoner parametrar AI bygger vi ett nätverk av 100 och 1000 modeller som fungerar som en expertkompanjon för AI .

Vi tränar, bygger, testar, utvecklar, experimenterar och använder våra egna AI -modeller på vår egen noggrant utvalda kunskap och data.

Att lära dem att bli specialister i en värld av generalister.

Istället för att erbjuda 100-tals förskrivningar på templates som ofta saknar relevans för dina behov släpper vi templates som vi särskilt har utforskat, samlat in kunskap och tränat våra AI:er att behärska.

Välj rätt AI skrivverktyg för dig själv

Det är en enkel fråga: Vad föredrar du?

En yrkesman med ett års erfarenhet eller en med 10 års djup kunskap inom det område du behöver?

Behöver en advokat som ska skriva pålitliga avtal också veta hur man skriver de mest engagerande bloggarna om recept på chokladmuffins?

Med vår metodik för mindre målinriktade AI -modeller kan vi lära dem varför, hur och hur vissa format och skrivstilar ser ut.

Vår modell för långa formulär har till exempel tränats på mer än 10 miljoner mycket engagerande bloggar.

De förstår att långvarigt innehåll består av ett engagerande intro till en informativ huvuddel med en slutsats som sammanfattar allting.

Att anpassa AI -modellerna till våra användares behov är vårt dagliga bröd.

Varje dag strävar vi efter att utöka detta nätverk av AI -experter och vi tar med dem i varje textruta du behöver dem.

Är du en ivrig författare?

Kolla in vår chrome extension hyperladdning av din skapelse i alla textfält som finns.

Är du en utvecklare som letar efter en lösning för NLG AI ? Kontakta oss för att testa vår API.

Vill du bidra med data till vår sak? Var gärna vår gäst.

Låt oss bygga kreativa AI:er med syfte!

.jpg)