Kreativt innehåll API på webben

Oavsett om du är ett mjukvaruföretag som vill införa ett verkligt mervärde för sina slutanvändare, eller om du behöver klassificering och generering av text i stor skala.

Är du redo att öka produktiviteten i ditt arbetsflöde med kraften i stora språkmodeller? Utan all smärta med infrastrukturen?

Gör ditt arbetsflöde smart med naturlig språkbehandling, generering och maskinkreativitet.

Inga miljöproblem, ingen brist på GPU:er, inga problem med prompter, inga överbelastade servrar, ingen optimering av parametrar.

Bara ren NLP kraft för dina arbetsflöden och produkter. Så att du kan fokusera på den produkt du vill få ut.

Varje lösning är en enkel integrering av en API slutpunkt i din kodbas.

Vi hjälper dig att hitta rätt prismodell för din uppgift.

VÄLJ DIN MODELL

Det finns så många modeller och det känns som om alla har sin egen karaktär. Vi hjälper dig att välja de bästa arbetsmodellerna för ditt arbetsflöde. Inom NeoCortex-systemet finns det 4 kategorier.

Där Velox är de snabbaste modellerna och Alta är de mest kraftfulla. Sophos-modellerna är våra finjusterade NeoCortex-expertmodeller för mycket specialiserade arbetsflöden.

Dessa modeller kan användas för en mängd olika ändamål, bland annat klassificering, utvinning av enheter, sammanfattning, innehållsgenerering, kodgenerering, parafrasering och mycket mer.

Velox

Aecus

Alta

Sophos

Kort beskrivning

den snabba

den balanserade

de starka

experten

Pris per 1K Tokens

$0.01

$0.02

$0.04

$0.12

Flerspråkigt tillägg

(pris per 1 000 tokens)

+$0.12

+$0.12

+$0.12

+$0.12

Finjustering

på begäran

på begäran

på begäran

på begäran

Dedikerade GPU:er

på begäran

på begäran

på begäran

på begäran

Parameter Storlek

Upp till 5 miljarder

Upp till 19 miljarder

Över 20 miljarder

-

Got data? Let’s bring your models to the next level

FINE-TUNING - IMPROVE PERFORMANCE AND EFFICIENCY

Out of the box models are not made for your specific pain points?

That’s why we help you nail them down to what you need. With fine-tuned models on your data and workflow we can achieve better results while reducing overall costs in a number of tasks.

A small set of 100 examples can:

- improve task performance by 10x

- lead to 28% cost reduction

.png)

Ta med din egen modell

Har du nått vägs ände med din optimering?

Du lyckas inte sätta en större modell på din infrastruktur. Vi hjälper dig att vara värd för din egen modell och hantera pågående optimering.

- Tar bort 70 % av arbetet med att skapa text.

- Anpassa textgenerering för att matcha dina användare, din bransch och din nisch.

- Lägg till en oslagbar tidsbesparing till ditt värdeerbjudande

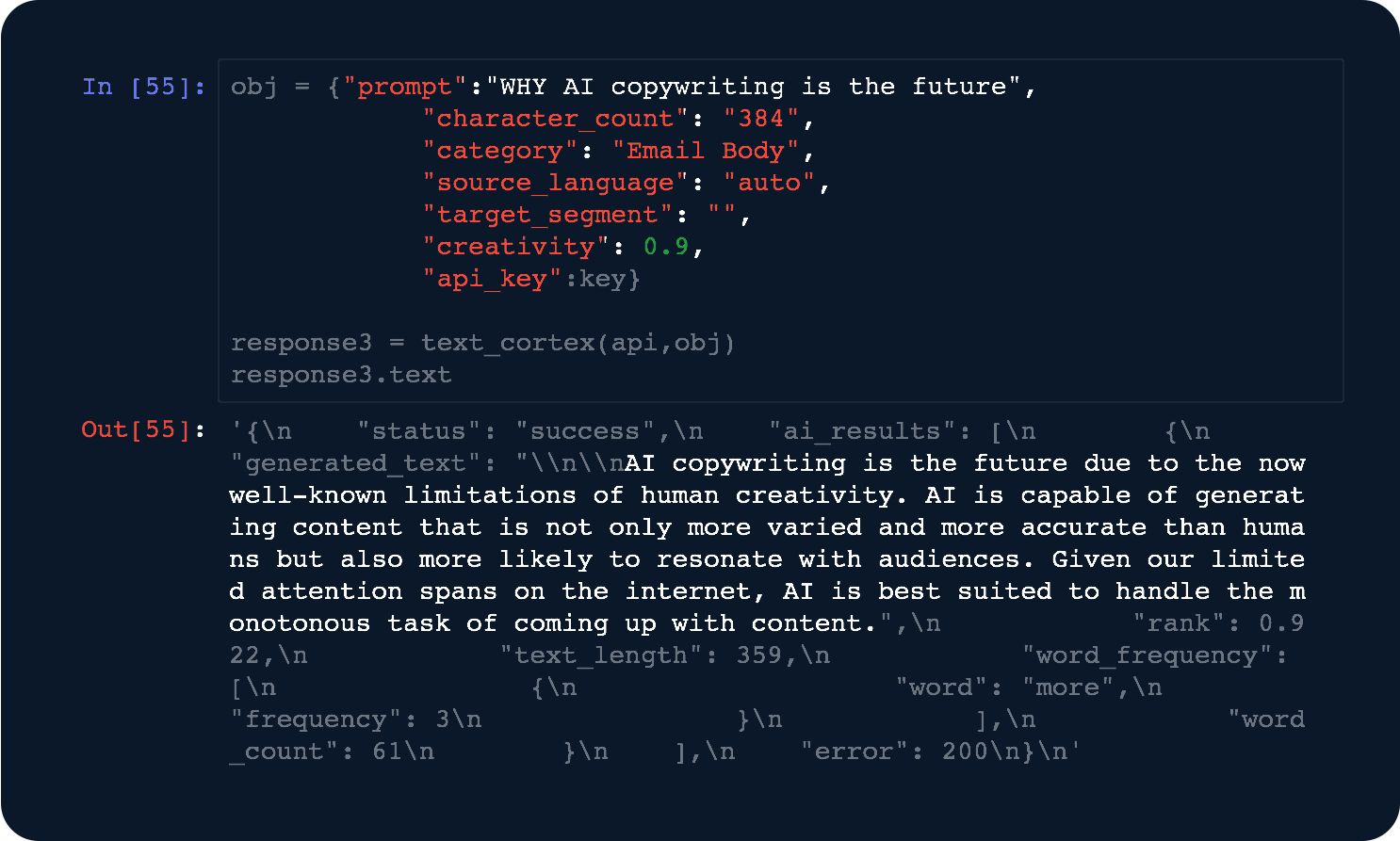

Kraftfulla och lättanvända API:er

Utvecklare i hjärtat

Från utvecklare för utvecklare. Integrera dig i vår API med mindre än tre rader kod.

- Avancerade optimeringar - Vi justerar ständigt modellerna för att uppnå bästa möjliga svarshastighet.

- Dedikerade beräkningar - Få tillgång till högre prestanda med dedikerad beräkningskraft.

Gör ditt arbetsflöde smart

Letar du efter en tjänst som värd för din stora språkmodell som API? Har du svårt att skapa en större modell i din egen infrastruktur?

Vi hjälper dig att vara värd för din egen modell och sköta den löpande optimeringen.

Omskrivning av text API

Ge ditt arbetsflöde eller dina användare möjlighet att skriva om vad som helst.

Sammanfattning av text API

Sammanfatta allt i ditt arbetsflöde för att underlätta matsmältningen.

Generering av text API

Skapa innehåll för långa artiklar, e-postmeddelanden och inlägg i sociala medier.

Visuell generering API

Använd Stabil Diffusion för att skapa visuella utkast i ditt arbetsflöde.

Några av de vanligaste frågorna

En token är en branschterm för den volym som våra modeller arbetar med. Från den input som du ger dem att arbeta med till den output som de genererar åt dig.

Tänk på dem som att betala för liter vatten som du förbrukar från stadens system och som du sedan släpper tillbaka till det.

Tokens är en form av mätning som kan uttryckas i olika enheter, t.ex. att 1 liter vatten är detsamma som 1 000 milliliter vatten. På samma sätt består 1 token av 4 tecken.

Visste du för övrigt att ett genomsnittligt ord består av 4,5 tecken? Så 1 symbol är nästan ett ord!

För att sätta allt detta i perspektiv igen. Texten fram till här har cirka 670 tecken, 124 ord och utgör ungefär 169 tokens.

Om Alta hade skapat detta block skulle det ha kostat:

[antal totala tokens] x [Alta-pris per token] = kostnad

169 x 0,00002 = 0,0038 USD

Vi arbetar oftast med våra egna NeoCortex-modeller.

Andra modeller som vi kan hysa, optimera och driva åt dig är:

- GPT Neo 2.7 bn.

- GPT-J 6 bn.

- GPT NeoX 20 bn.

- OPT: Open Pre-trained Transformer Language Models (125M to 66 bn)

- FairSeq (13 bn.)

- CodeGen (16 bn.)

- Bloom 560m

- Bloom 1.1 bn.

- Bloom 1.7 bn.

- Bloom 3 bn.

- Bloom 7.1 bn.

- Bloom 176 bn. (snart tillgänglig)

- t5 Small

- t5 Base

- t5 Large

- t5 3b

- t5 11b

- Stable Diffusion hosted API

Om du har fler frågor kan du kontakta vårt integrationsteam.

Vi beräknar dina avgifter utifrån hur många input- och output tokens du arbetar med.

En generationsuppgift med vår "Aecus"-modell för LongForm är oftast mycket outputintensiv.

Tänk på följande inmatning:

"NeoCortex textgenerering API hjälper dig i ditt arbetsflöde" (60 tecken = 15 tokens)

Här är den faktiska utmatningen:

"Vad är NeoCortex?

NeoCortex är en textgenerering med djupinlärning API, som endast använder naturligt språk för att generera texter. Den genererade texten är utformad för att vara människoläsbar och begriplig, vilket hjälper dig i ditt arbetsflöde. API är lätt att lära sig, med ett enkelt gränssnitt. Detta gör den perfekt för användning av utvecklare som vill skapa egna applikationer." (360 tecken = 90 Tokens)

Ger ett totalt antal Tokens på 15 + 90 = 105 Tokens.

0,02 $ dividerat med 1000 gånger 105 = 0,0021 $ skulle debiteras för din begäran.

Ja.

När du registrerar dig till vår plattform och genererar en API -nyckel får du automatiskt 5 dollar för att prova våra API:er i 30 dagar.

Om du vill ha hjälp med din integration kan du kontakta vårt integrationsteam.

När vi finjusterar dina modeller tar vi dina data och lär en modell hur den ska bete sig på dessa data och vad som förväntas.

Som en fin kostym skräddarsyr vi en modell för textgenerering, klassificering och extraktion utifrån dina behov.

Allt vi behöver från dig är ett dataset med högkvalitativa data från ditt arbetsflöde.

Vi ser de första förbättringarna från dataset som är så små som 500 observationer.

Om du har fler frågor kan du kontakta vårt integrationsteam.

Ja.

Base-funktioner kräver mindre än tre rader kod. Därför har vi också flera OSS-paket för enkel integration(PyPi, NPM-JS).

Dessutom erbjuder vi dig ett dedikerat integrationssupport under din inkörningstid.

Medan nykomlingar behöver cirka 4 till 6 veckor för att se de första resultaten. Någon som byter till vår infrastruktur finner sig tillrätta på mindre än 2 veckor.

Vi försöker hantera våra API -slutpunkter så självförklarande som möjligt. Vi hjälper dig alltid gärna att hitta den bästa modellen.

Om du behöver direkt vägledning kan du kontakta vårt integrationsteam.

För att köra stora språkmodeller (LLM) krävs kraftfulla datorer i form av GPU:er.

Det är dyrt att bygga upp infrastrukturen, underhålla och optimera den. Vi är experter på detta och har skalat ner våra modeller för våra användarvänliga produkter där svarstider i "ms" spelar roll och kostnadsoptimering är vår marginalfaktor.

Med TextCortex har du fördelen att kunna dra nytta av vårt NeoCortex-system på två kostnadsbesparande sätt:

1) Pay-per-token

Idealisk för verksamhet i mindre skala. Till exempel mindre 100 000 förfrågningar per månad eller mindre modeller med mindre än 10 miljarder parametrar.

Du kör i en delad miljö med andra kunder.

2) Pay-per-GPU-hour

Idealisk för storskalig processverksamhet. Till exempel miljontals förfrågningar eller modeller med mer än 20 miljarder parametrar.

Du betalar oss för hantering och hosting av modeller beroende på den fasta aktiva GPU-timmarta som dina modeller körs.

Detta är ett prioriterat alternativ där du kör dedikerade resurser bara för ditt fall.

Om du behöver mer vägledning kan du kontakta vårt integrationsteam.

AI copilot för din kunskap.

Koppla ihop dina kunskaper och arbeta med dina egna data.