Meta AI ha introdotto un LLM che si avvicina all'attuale tecnologia AI annunciando il modello Llama 3 il 18 aprile 2024. Sebbene il modello LLama 3 sia più avanzato del suo predecessore, il modello LLama 2, è nel complesso un concorrente di modelli linguistici di grandi dimensioni di livello medio come GPT-3.5 e Claude 3 Sonnet. Il modello LLama 3 di Meta AI promette un ragionamento migliorato, dati più addestrati e comprensione del linguaggio rispetto al suo predecessore. Se ti stai chiedendo il modello Llama 3, sei nel posto giusto!

In questo articolo esploreremo insieme il modello Llama 3 e le sue caratteristiche.

Se sei pronto, iniziamo!

TL; DR

- Il modello Llama 3 è un modello linguistico di grandi dimensioni sviluppato da Meta AI e annunciato il 18 aprile 2024.

- Llama 3 è disponibile in due dimensioni di modello adatte a diversi casi d'uso: 8B e 70B.

- Puoi visitare il sito Web ufficiale di Meta AI per accedere al modello Llama 3, ma Llama 3 non è attualmente disponibile in tutti i paesi.

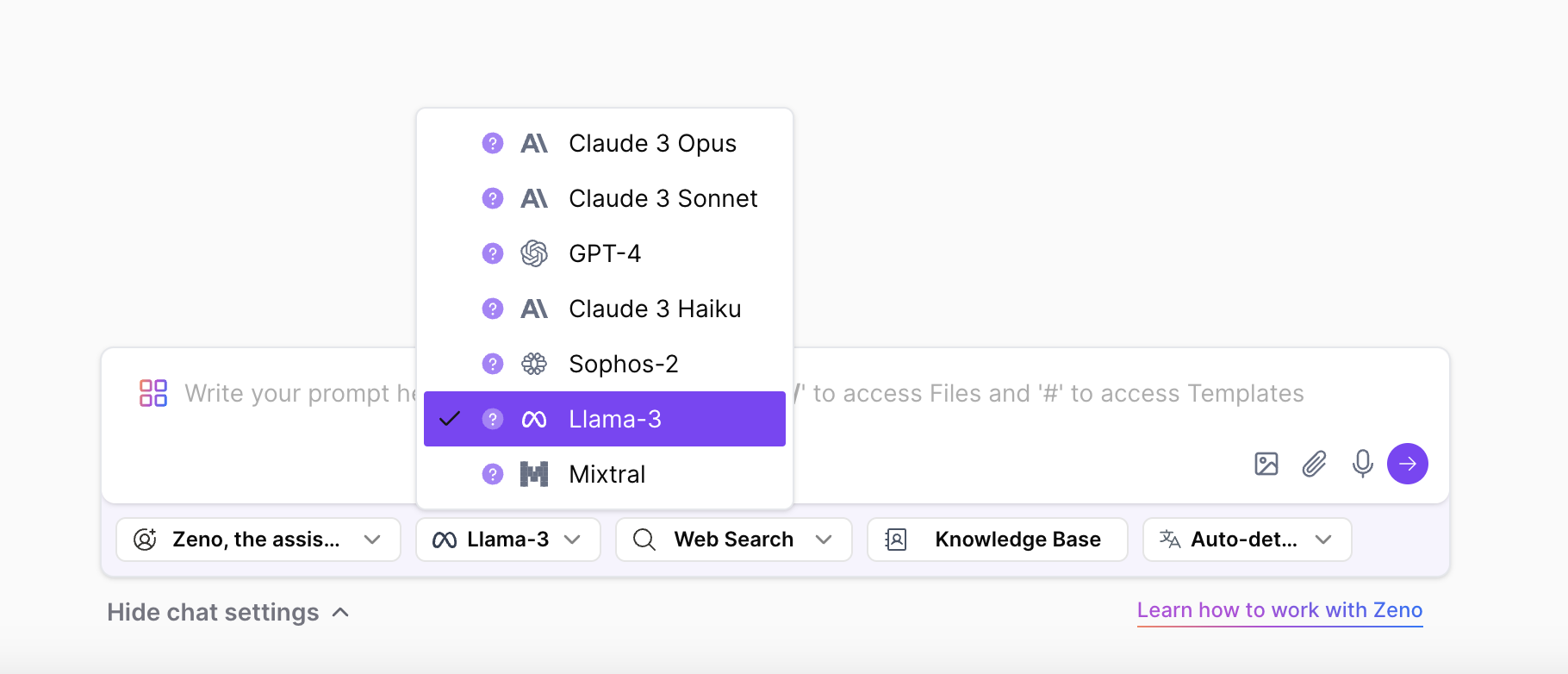

- Se vuoi accedere al modello Llama 3 in tutto il mondo, ZenoChat di TextCortex è il tuo salvatore.

- Il modello Llama 3 è riuscito a superare i suoi rivali, i modelli Gemini Pro 1.5 e Claude 3 Sonnet, nei benchmark.

- Il modello Llama 3 viene addestrato con dati di alta qualità e filtrati in modo speciale.

- Se stai cercando un'IA conversazionale migliore di Llama 3, ZenoChat di TextCortex è progettato per te con le sue opzioni di personalizzazione e le capacità di output di testo e immagini.

Recensione di Llama 3 di Meta AI

Il modello Llama 3 è un modello linguistico di grandi dimensioni introdotto da Meta AI il 18 aprile 2024. Il modello Llama 3 offre caratteristiche e capacità di generazione di output migliorate rispetto al suo predecessore. Il modello Llama 3 mira a offrire prestazioni all'avanguardia in un'ampia gamma di settori con il suo ragionamento migliorato, la comprensione del linguaggio finemente sintonizzata e le nuove funzionalità.

Un altro obiettivo di Meta AI durante lo sviluppo del modello Llama 3 è quello di migliorarne l'utilità. Meta AI mirava ad aumentare l'efficienza del modello Llama 3 pubblicizzandolo alla community e agli sviluppatori di IA mentre era in fase di sviluppo. I piani futuri di Meta AI per il modello Llama 3 includono la sua realizzazione multilingue e multimodale, l'aumento della finestra di contesto e il miglioramento delle sue prestazioni.

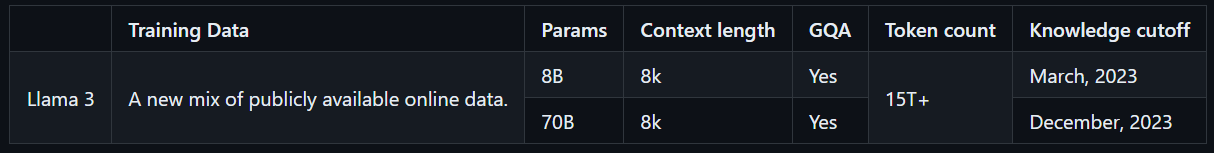

Llama 3 Dimensioni del modello

Llama 3 è disponibile in due dimensioni di modello adatte a diversi casi d'uso: 8B e 70B. Il modello Llama 3 8B è più compatto, con un totale di 8 miliardi di parametri, e può generare output più velocemente. D'altra parte, il modello Llama 3 70B ha un totale di 70 miliardi di parametri ed è adatto a compiti complessi. Inoltre, il modello Llama 3 8B viene addestrato con dati online disponibili pubblicamente fino a marzo 2023, mentre il modello Llama 3 70B viene addestrato con dati online disponibili pubblicamente fino a dicembre 2023.

Come accedere a Llama 3?

Per accedere al modello Llama 3, puoi visitare il sito Web ufficiale di Meta AI, fare clic sul pulsante "Inizia" e seguire i passaggi. Tuttavia, poiché il modello Llama 3 non è accessibile in tutto il mondo, ha un basso punteggio di disponibilità, a differenza di altri LLM. Tuttavia, ci sono modi per provare il modello Llama 3 in tutto il mondo.

Con ZenoChat di TextCortex, puoi accedere e provare entrambe le taglie del modello Llama 3 senza alcun limite. ZenoChat supporterà gli LLM Llama 3 8B e 70B oltre a GPT-4, Sophos 2, Mixtral, Claude 3 Opus e Sonnet LLM. Detto questo, puoi provare liberamente il modello Llama 3 senza le restrizioni nazionali di Meta AI.

Caratteristiche principali di Llama 3 di Meta AI

Llama 3, il modello più nuovo e avanzato di Meta AI, ha prestazioni più elevate e nuove funzionalità rispetto al suo predecessore. Il modello Llama 3 è stato introdotto come concorrente non degli LLM di fascia alta come GPT-4 e Gemini Ultra, ma di modelli più utilizzati come GPT-3.5 e Gemini Pro. Diamo un'occhiata più da vicino alle caratteristiche principali di Llama 3.

Prestazioni del modello

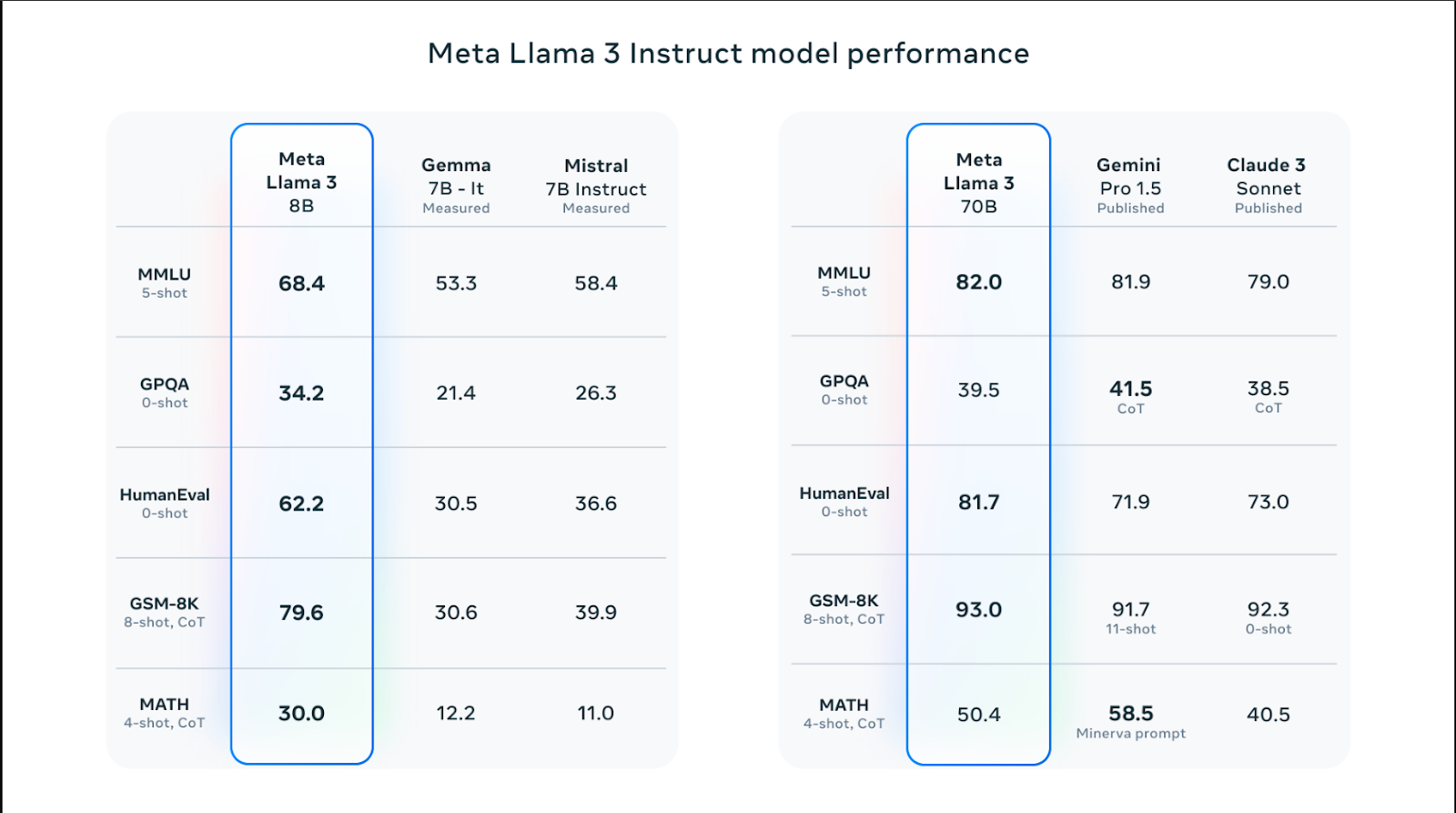

I modelli Llama 3 sono disponibili in diverse dimensioni e hanno prestazioni migliori rispetto ai modelli Llama 2 in abilità come il ragionamento, la generazione di codice, la matematica e il seguire le istruzioni. Tra i modelli Llama 3, il modello 70B ha superato modelli popolari come Claude 3 Sonnet e Gemini Pro 1.5 con un punteggio di 82,0 nel benchmark MMLU. Tuttavia, i modelli Llama 3 hanno prestazioni migliori rispetto ai modelli Claude 3 Sonnet e Gemini Pro 1.5 in tutti i benchmark ad eccezione del benchmark MATH, che misura le abilità matematiche, e del GPQA, che misura i punteggi Q&A a livello di laurea.

Il modello Llama 3 8B è riuscito a superare i suoi modelli rivali Gemma 7B e Mistral 7B nei benchmark Humaneval, MMLU, GPQA, GSM-8K e MATH. In altre parole, le dimensioni del modello Llama 3 hanno prestazioni più elevate rispetto ai modelli rivali.

Dati di addestramento

Il modello Llama 3 è stato addestrato con una grande quantità di dati, che è fondamentale per la creazione di un modello linguistico di grandi dimensioni ad alte prestazioni. In particolare, è stato addestrato con token 15T provenienti da fonti disponibili pubblicamente, 7 volte di più rispetto alla quantità di dati utilizzati per addestrare il modello Llama 2.

Inoltre, il modello Llama 3 è stato addestrato con un set di dati di alta qualità composto da 30 lingue diverse dall'inglese. Ciò ha comportato un aumento significativo della comprensione del linguaggio, della creatività e delle capacità di seguire i prompt del modello.

Il team di Meta AI ha sviluppato una serie di pipeline di filtraggio dei dati per addestrare il modello Llama 3 con dati affidabili e di alta qualità. Questi filtri includono parametri come il filtro NSFW, il filtro euristico, l'approccio di deduplicazione semantica e il classificatore di testo. Inoltre, poiché il modello Llama 2 è in grado di identificare dati di alta qualità, è stato utilizzato per filtrare i dati addestrati del modello Llama 3.

Ottimizzazione

I modelli Llama 3 sono appositamente ottimizzati per i modelli e le marche di GPU e CPU utilizzati di frequente. Maggiore è la quantità di software ottimizzato per hardware specifico, maggiori sono le prestazioni e più veloce sarà l'esecuzione. Il modello Llama 3 è ottimizzato per l'hardware Intel, AMD e Nvidia. Inoltre, Intel ha pubblicato una guida dettagliata sulle prestazioni del modello Llama 3.

Sicurezza

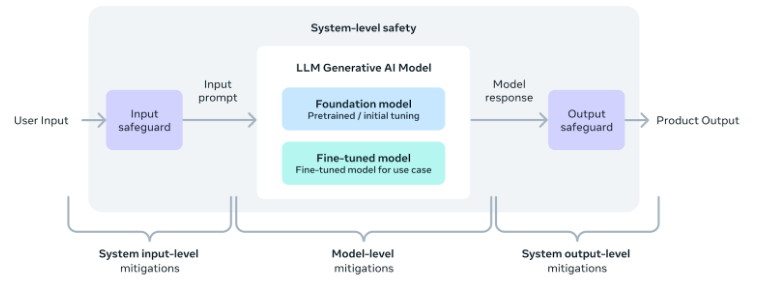

Il team di Meta AI riconosce l'importanza di un utilizzo sicuro degli strumenti e dei software di intelligenza artificiale, incluso il modello Llama 3. Di conseguenza, durante lo sviluppo del modello sono stati aggiunti parametri di sicurezza per garantire che il suo output sia sicuro, innocuo ed etico.

Inoltre, il team ha anche fornito una guida all'implementazione della sicurezza a livello di sistema per coloro che desiderano sviluppare applicazioni utilizzando il modello Llama 3. Con queste misure in atto, gli utenti possono godere della comodità e dei vantaggi degli strumenti di intelligenza artificiale utilizzandoli in modo sicuro e responsabile.

Un'alternativa migliore: ZenoChat di TextCortex

Se stai cercando un assistente AI personalizzabile con accesso a vari LLM, tra cui il modello Llama 3, ZenoChat di TextCortex è pensato per te. ZenoChat è uno strumento di intelligenza artificiale che offre ai suoi utenti i vantaggi di diversi LLM e non li limita a un singolo LLM. ZenoChat mira ad assistere i propri utenti in attività professionali e quotidiane come la generazione di testi, la parafrasi e la ricerca. Con ZenoChat, puoi velocizzare qualsiasi attività di 12 volte, ridurre il carico di lavoro e far salire alle stelle la tua produttività.

ZenoChat è disponibile come applicazione web e browserextension. Il browser ZenoChat extension è integrato con 30.000+ siti web e app. Quindi, può continuare a supportarti ovunque e in qualsiasi momento.

Lavora con le tue conoscenze e i tuoi dati

ZenoChat offre un'esperienza AI completamente personalizzabile grazie alle nostre funzionalità "Knowledge Bases" e "Individual Personas". La nostra funzione "Personas individuali" ti consente di regolare lo stile di output di ZenoChat, la lunghezza delle frasi, l'emozione dominante nelle frasi e la personalità come desideri. In altre parole, puoi utilizzare questa funzione per trasformare ZenoChat nel tuo assistente personale o nel tuo gemello digitale.

La nostra funzione "Knowledge Bases" ti consente di caricare o collegare fonti di dati che ZenoChat utilizzerà per generare output. Utilizzando questa funzione, è possibile addestrare ZenoChat con i propri dati e renderlo adatto a casi d'uso specifici. Inoltre, grazie a questa funzione, puoi riassumere centinaia di pagine di documenti con un unico prompt o chattare con i tuoi PDF. La nostra funzione "Knowledge Base" ha anche un pulsante che ti consente di integrare il tuo Google Drive o Microsoft OneDrive in pochi secondi.

%20(8).png)

%20(20).png)