Conteúdo criativo API da web

Quer seja uma empresa de software que pretende adoptar um verdadeiro valor acrescentado para os seus utilizadores finais, quer necessite de classificação e geração de texto em grande escala.

Está pronto para 4x a produtividade do seu fluxo de trabalho com o poder de modelos de linguagem de grande dimensão? Sem toda a dor de infra-estrutura?

Torne o seu fluxo de trabalho inteligente com processamento de linguagem natural, geração e criatividade da máquina.

Sem problemas ambientais, sem escassez de GPU, sem problemas de prompting, sem servidores sobrecarregados, sem optimização de parâmetros.

Apenas energia pura NLP para os seus fluxos de trabalho e produtos. Assim, pode concentrar-se no produto que pretende obter.

Cada solução é uma simples integração de um endpoint API na sua base de códigos.

Ajudamos-te a encontrar o modelo de preço certo para a tua tarefa

ESCOLHA O SEU MODELO

Tantos modelos e todos eles sentem que têm o seu próprio carácter. Ajudamo-lo a escolher os melhores modelos de trabalho para o seu fluxo de trabalho. Dentro do sistema NeoCortex existem 4 categorias.

Onde Velox são os modelos mais rápidos e Alta são os mais poderosos. Os modelos Sophos são os nossos modelos especializados NeoCortex afinados para fluxos de trabalho altamente especializados.

Estes modelos podem ser utilizados para diversos fins, incluindo classificação, extracção de entidades, sumarização, geração de conteúdos, geração de códigos, paráfrases, e muito mais.

Velox

Aecus

Alta

Sophos

Descrição breve

o jejum

o equilibrado

os fortes

o perito

Preço por fichas de 1K

$0.01

$0.02

$0.04

$0.12

Sobretaxa Multilingue

(Preço por 1K Tokens)

+$0.12

+$0.12

+$0.12

+$0.12

Sintonia fina

a pedido

a pedido

a pedido

a pedido

GPUs dedicados

a pedido

a pedido

a pedido

a pedido

Tamanho do Parâmetro

Até 5 biliões

Até 19 biliões

Mais de 20 biliões

-

Got data? Let’s bring your models to the next level

FINE-TUNING - IMPROVE PERFORMANCE AND EFFICIENCY

Out of the box models are not made for your specific pain points?

That’s why we help you nail them down to what you need. With fine-tuned models on your data and workflow we can achieve better results while reducing overall costs in a number of tasks.

A small set of 100 examples can:

- improve task performance by 10x

- lead to 28% cost reduction

.png)

Traga o seu próprio modelo

Chegaste ao fim do caminho com a tua optimização?

Não consegues colocar um modelo maior na tua infra-estrutura. Ajudamos-te a alojar o teu próprio modelo e a lidar com a optimização contínua.

- Retira 70% do trabalho de criação de texto

- Personalize a geração de texto para corresponder aos seus utilizadores, indústria e nicho

- Acrescente uma imbatível poupança de tempo à sua proposta de valor

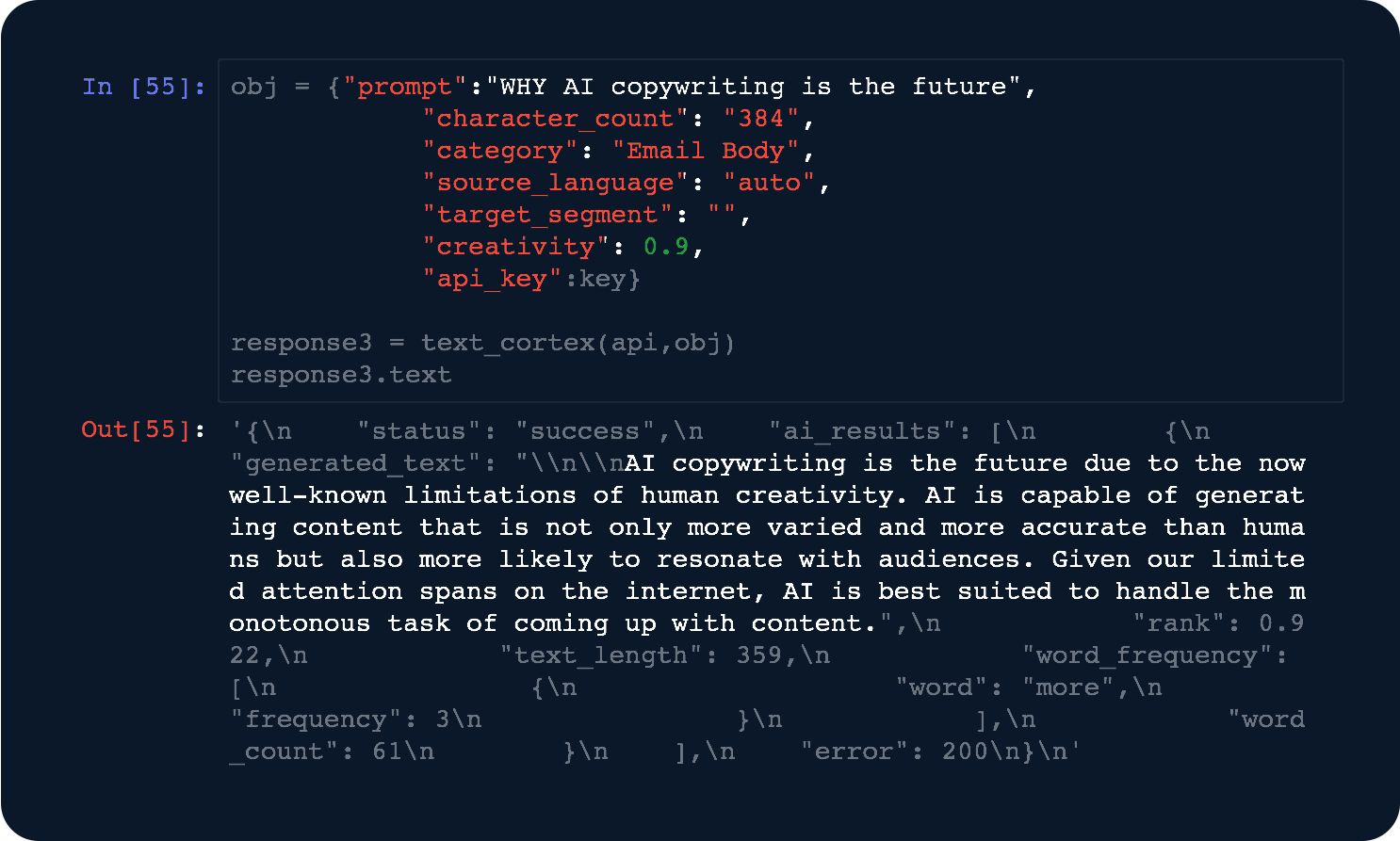

APIs poderosas e fáceis de usar

DESENVOLVEDORES NO CORAÇÃO

De desenvolvedores para desenvolvedores. Integra-te no nosso API em menos de 3 linhas de código.

- Optimizações avançadas - Estamos constantemente a afinar modelos para alcançar as melhores velocidades de resposta.

- Computações Dedicadas - Desbloqueie um desempenho superior com poder computacional dedicado.

Torne o seu fluxo de trabalho inteligente

Procura um serviço para alojar o seu modelo linguístico de grandes dimensões em API? Está com dificuldades em criar um modelo de maiores dimensões na sua infra-estrutura?

Ajudamo-lo a alojar o seu próprio modelo e a tratar da optimização contínua.

Reescrita de texto API

Dê ao seu fluxo de trabalho ou aos seus utilizadores o poder infinito de reescrever qualquer coisa.

Sumário de texto API

Resuma qualquer coisa no seu fluxo de trabalho para facilitar a digestão.

Geração de texto API

Criar conteúdo para artigos de forma longa, emails, posts nas redes sociais.

Geração visual API

Utilize Difusão Estável para criar rascunhos visuais no seu fluxo de trabalho.

Algumas das perguntas mais frequentes

Um símbolo é o termo da indústria para o volume que os nossos modelos operam. Desde a entrada que lhes é dada para trabalharem até à saída que estão a gerar para si.

Pense neles como pagar por litros de água que consome do sistema da sua cidade e drenar de volta para ele.

As fichas são uma forma de medida que pode ser expressa em unidades diferentes como 1 litro de água é o mesmo que 1000 mililitros de água. Da mesma forma, 1 ficha é composta por 4 caracteres.

BTW sabia que a palavra média consiste em 4,5 caracteres? Então 1 ficha é quase uma palavra!

Para colocar tudo isto novamente em perspectiva. O texto até aqui tem cerca de 670 caracteres, 124 palavras e faz cerca de 169 fichas.

Se Alta tivesse criado este bloco teria custado:

[# do total de fichas] x [por preço de ficha de Alta] = custo

169 x 0,00002 = 0,0038 USD

Trabalhamos a maior parte do tempo com os nossos próprios modelos NeoCortex proprietários.

Outros modelos que podemos alojar, optimizar e operar para si incluem:

- GPT Neo 2.7 bn.

- GPT-J 6 bn.

- GPT NeoX 20 bn.

- OPT: Modelos Abertos de Linguagem de Transformador Pré-treinado (125M a 66 bn.)

- FairSeq (13 bn.)

- CodeGen (16 bn.)

- Bloom 560m

- Bloom 1.1 bn.

- Bloom 1.7 bn.

- Bloom 3 bn.

- Bloom 7.1 bn.

- Bloom 176 bn. (disponível brevemente)

- t5 Pequeno

- t5 Base

- t5 Grande

- t5 3b

- t5 11b

- Difusão Estável alojada API

Caso tenha mais perguntas, contacte a nossa equipa de integração.

Calculamos os seus custos pela quantidade de fichas de entrada e saída com que está a trabalhar.

Uma tarefa de geração com o nosso modelo "Aecus" para LongForm é, na maioria das vezes, muito pesada em termos de saída.

Pense no seguinte aviso de entrada:

"A geração de texto NeoCortex API ajuda-o no seu fluxo de trabalho" (60 caracteres = 15 fichas)

Aqui está a saída real:

"O que é o NeoCortex?

NeoCortex é uma geração de texto de aprendizagem profunda API, que utiliza apenas linguagem natural para gerar textos. O texto gerado é concebido para ser legível e compreensível para o ser humano, ajudando-o no seu fluxo de trabalho. O API é fácil de aprender, com uma interface simples. Isto torna-o perfeito para utilização por programadores que queiram criar as suas próprias aplicações". (360 caracteres = 90 fichas)

Faz uma contagem total de fichas de 15 + 90 = 105 fichas.

0,02$ dividido por 1000 vezes 105 = 0,0021 $ seria cobrado pelo seu pedido.

Sim.

Quando você inscreva-se para a nossa plataforma e gerar uma chave API tem automaticamente $5 para experimentar as nossas APIs durante 30 dias.

Para obter ajuda em torno da sua integração, contacte a nossa equipa de integração.

Quando afinamos os seus modelos estamos a levar os seus dados e a ensinar um modelo a comportar-se sobre eles e o que se espera.

Como um bonito fato, estamos a adaptar-lhe uma geração de texto, classificação, modelo de extracção sobre as suas próprias necessidades.

Tudo o que precisamos de si é um conjunto de dados com dados de alta qualidade do seu fluxo de trabalho.

Vemos primeiro melhorias de conjuntos de dados tão pequenos como 500 observações.

Caso tenha mais perguntas , contacte a nossa equipa de integração.

Sim.

As funcionalidades de base requerem menos de 3 linhas de código. Por este motivo, temos também múltiplos pacotes OSS para fácil integração(PyPi, NPM-JS).

Além disso, oferecemos-lhe um apoio dedicado à integração para o seu tempo de bordo.

Enquanto os recém-chegados requerem cerca de 4 a 6 semanas para verem os primeiros resultados. Alguém que mude para a nossa infra-estrutura encontra o seu caminho em menos de 2 semanas.

Enquanto tentamos gerir os nossos parâmetros API tão autoexplicativos quanto possível. Estamos sempre dispostos a ajudá-lo a encontrar o melhor modelo.

No caso de procurar orientação directa, contacte a nossa equipa de integração.

A execução de grandes modelos linguísticos (LLM) requer uma poderosa maquinaria informática sob a forma de GPUs.

A construção da infra-estrutura, a manutenção e a optimização da mesma tem um custo elevado. Somos especialistas em ter reduzido os nossos modelos para os nossos produtos de face a face com o utilizador, onde os tempos de resposta em "ms" são matéria e optimização de custos.

Com TextCortex tem o benefício de beneficiar do nosso sistema NeoCortex de duas formas de poupança de custos:

1) Pay-per-token

Ideal para operações de menor escala. Por exemplo, menos 100k pedidos por mês ou modelos menores com menos de 10 bn. parâmetros.

Funciona num ambiente partilhado com outros clientes.

2) Pay-per-GPU-hour

Ideal para operações de processo em grande escala. Por exemplo, milhões de pedidos ou modelos com mais de 20 bn. parâmetros.

Paga-nos pela gestão e alojamento de modelos dependendo da tarifa horária fixa activa da GPU que os seus modelos executam.

Esta é uma opção prioritária na qual executa recursos dedicados apenas para o seu caso.

No caso de procurar mais orientação , contacte a nossa equipa de integração.

Copiloto de IA para o teu conhecimento.

Liga os teus conhecimentos e trabalha com os teus próprios dados.