웹의 크리에이티브 콘텐츠 API

최종 사용자를 위한 진정한 부가가치를 도입하고자 하거나 대규모 텍스트 분류 및 생성이 필요한 소프트웨어 회사라면

대규모 언어 모델의 강력한 성능으로 워크플로 생산성을 4배로 높일 준비가 되셨나요? 인프라에 대한 고민 없이요?

자연어 처리, 생성 및 기계의 창의성을 통해 워크플로를 스마트하게 만드세요.

환경 문제, GPU 부족, 프롬프트 문제, 서버 과부하, 매개변수 최적화가 없습니다.

오직 워크플로우와 제품을 위한 순수한 NLP 파워만 있습니다. 따라서 원하는 제품에 집중할 수 있습니다.

각 솔루션은 API 엔드포인트를 코드베이스에 간단히 통합하는 것입니다.

귀사의 업무에 적합한 가격 모델을 찾을 수 있도록 도와드립니다.

모델 선택

수많은 모델들이 저마다의 개성을 가지고 있는 것 같습니다. 작업 흐름에 가장 적합한 작업 모델을 선택할 수 있도록 도와드립니다. 네오코텍스 시스템에는 4가지 카테고리가 있습니다.

여기서 벨록스는 가장 빠른 모델이고 알타는 가장 강력한 모델입니다. Sophos 모델은 고도로 전문화된 워크플로우를 위해 세밀하게 조정된 네오코텍스 전문가 모델입니다.

이 모델은 분류, 엔티티 추출, 요약, 콘텐츠 생성, 코드 생성, 의역 등 다양한 용도로 사용할 수 있습니다.

Velox

Aecus

Alta

Sophos

간단한 설명

단식

균형 잡힌

강한 자

전문가

1K 토큰당 가격

$0.01

$0.02

$0.04

$0.12

다국어 추가 요금

(1K 토큰당 가격)

+$0.12

+$0.12

+$0.12

+$0.12

미세 조정

요청 시

요청 시

요청 시

요청 시

전용 GPU

요청 시

요청 시

요청 시

요청 시

매개변수 크기

최대 50억

최대 190억

200억 이상

-

Got data? Let’s bring your models to the next level

FINE-TUNING - IMPROVE PERFORMANCE AND EFFICIENCY

Out of the box models are not made for your specific pain points?

That’s why we help you nail them down to what you need. With fine-tuned models on your data and workflow we can achieve better results while reducing overall costs in a number of tasks.

A small set of 100 examples can:

- improve task performance by 10x

- lead to 28% cost reduction

.png)

나만의 모델 가져오기

최적화가 막바지에 이르렀나요?

인프라에 더 큰 모델을 구축할 수 없으신가요? 자체 모델을 호스팅하고 지속적인 최적화를 처리할 수 있도록 도와드립니다.

- 텍스트 작성 작업의 70%를 줄여줍니다.

- 사용자, 업계 및 틈새 시장에 맞게 텍스트 생성을 맞춤 설정하세요.

- 가치 제안에 탁월한 시간 절약 효과를 더하세요.

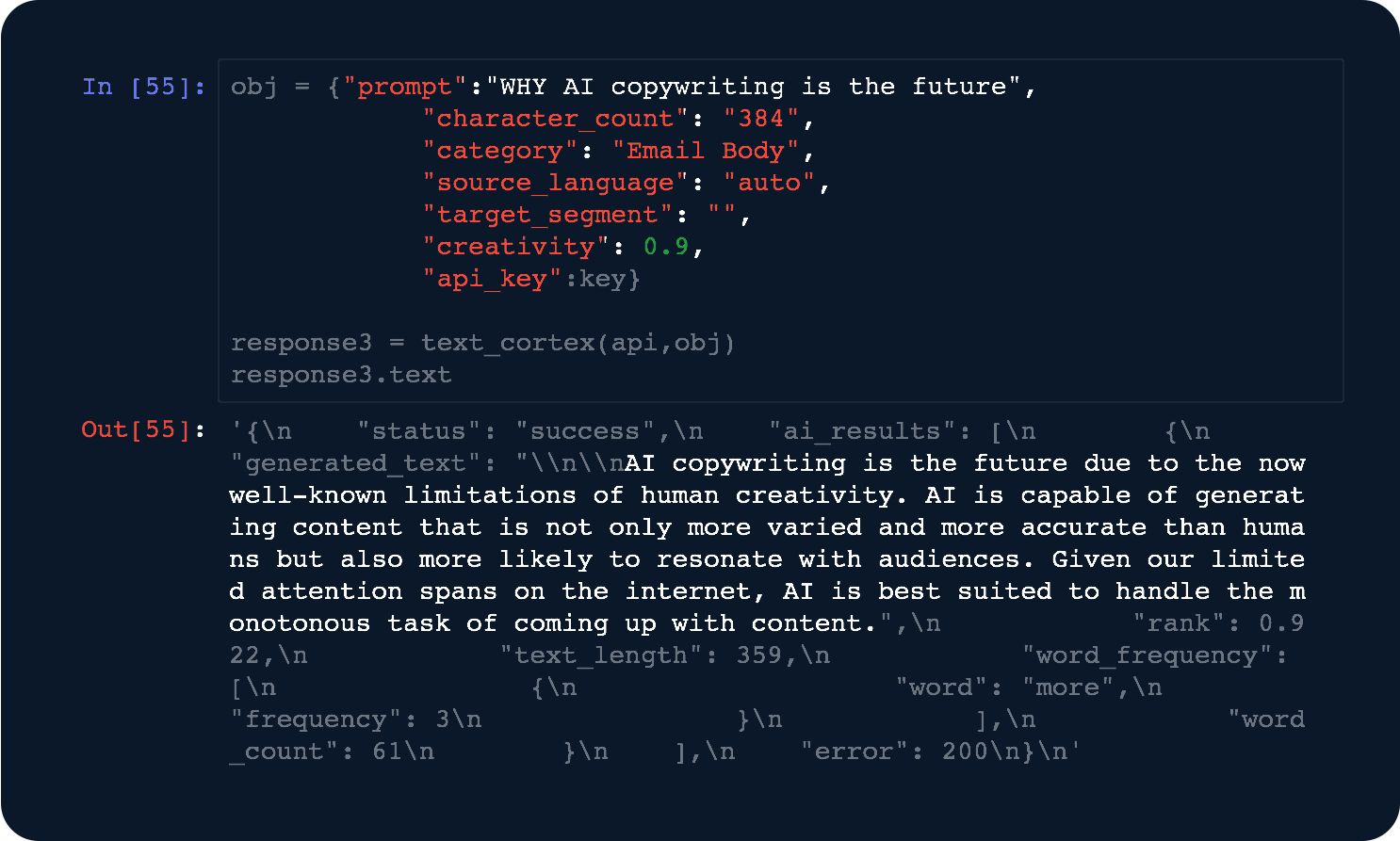

강력하고 사용하기 쉬운 API

개발자의 마음

↪CF_200D↩

개발자를 위한 개발자의 개발자입니다. 코드 3줄 이내로 API 에 통합하세요.

- 고급 최적화 - 최고의 응답 속도를 달성하기 위해 지속적으로 모델을 조정하고 있습니다.

- 전용 컴퓨팅 - 전용 컴퓨팅 성능으로 더 높은 성능을 활용하세요.

스마트한 워크플로 만들기

대규모 언어 모델을 API 으로 호스팅할 서비스를 찾고 계신가요? 인프라에서 대규모 모델을 만드는 데 어려움을 겪고 계신가요?

자체 모델을 호스팅하고 지속적인 최적화를 처리할 수 있도록 도와드립니다.

가장 자주 묻는 질문 몇 가지

토큰은 당사 모델이 작동하는 볼륨을 나타내는 업계 용어입니다. 사용자가 작업하도록 제공하는 입력부터 사용자를 위해 생성하는 출력까지.

도시 시스템에서 소비하고 다시 배수하는 물 1리터에 대한 비용을 지불한다고 생각하면 됩니다.

토큰은 1리터의 물이 1000밀리리터와 동일하듯이 다양한 단위로 표현할 수 있는 측정 형태입니다. 마찬가지로 1토큰은 4문자로 구성됩니다.

참고로 평균 단어가 4.5자로 구성되어 있다는 사실을 알고 계셨나요? 따라서 1토큰은 거의 한 단어에 해당합니다!

이 모든 것을 다시 한 번 원근법으로 설명해 보겠습니다. 여기까지의 텍스트는 약 670자, 124개의 단어로 구성되어 있으며 대략 169개의 토큰을 생성합니다.

만약 알타가 이 블록을 생성했다면 비용은 다음과 같습니다:

[총 토큰 수] x [알타의 토큰당 가격] = 비용

169 x 0.00002 = 0.0038 USD

당사가 고객을 위해 호스팅, 최적화 및 운영할 수 있는 다른 모델은 다음과 같습니다:

- GPT Neo 27억 달러

- GPT-J 60억 달러

- GPT NeoX 20억 달러

- OPT: 사전 훈련된 개방형 트랜스포머 언어 모델(1억 2,500만~660억 원)

- 페어세크(130억 원)

- 코드젠(160억 원)

- 블룸 560억 원

- 블룸 11억 원

- 블룸 17억 원

- 블룸 30억 원

- 블룸 71억 원

- 176억 원. (곧 제공 예정)

- t5 Small

- t5 Base

- t5 Large

- t5 3b

- t5 11b

- Stable Diffusion 호스팅 API

추가 질문이 있는 경우 통합 팀에 문의하세요.

작업하는 입력 및 출력 토큰의 양에 따라 요금을 계산합니다.

LongForm용 "Aecus" 모델을 사용한 생성 작업은 대부분 매우 많은 양의 출력을 필요로 합니다.

다음 입력 프롬프트를 생각해 보세요:

"NeoCortex 텍스트 생성 API 은 워크플로우에 도움이 됩니다" (60자 = 15토큰)

다음은 실제 출력입니다:

"NeoCortex란 무엇인가요?

NeoCortex는 딥러닝 텍스트 생성 API 으로, 자연어만을 사용하여 텍스트를 생성합니다. 생성된 텍스트는 사람이 읽고 이해할 수 있도록 설계되어 워크플로우에 도움이 됩니다. API 은 간단한 인터페이스로 배우기 쉽습니다. 따라서 자신만의 애플리케이션을 만들고자 하는 개발자가 사용하기에 적합합니다." (360자 = 토큰 90개)

총 토큰 수는 15 + 90 = 105개입니다.

0.02$를 1000 곱하기 105 = 0.0021$로 나눈 금액이 요청에 청구될 것입니다.

모델을 미세 조정할 때는 데이터를 가져와서 모델에 데이터에서 작동하는 방법과 예상되는 사항을 가르칩니다.

멋진 정장을 맞춤 제작하듯, 고객의 필요에 따라 텍스트 생성, 분류, 추출 모델을 맞춤화합니다.

고객에게 필요한 것은 워크플로우의 고품질 데이터가 포함된 데이터 세트뿐입니다.

우리는 500개 정도의 작은 데이터 세트에서 첫 번째 개선 사항을 확인합니다.

더 궁금한 점이 있으면 통합 팀에 문의하세요.

저희는 API 엔드포인트를 가능한 한 이해하기 쉽게 관리하려고 노력합니다.

직접적인 안내가 필요한 경우 통합 팀에 문의하세요.

대규모 언어 모델(LLM)을 실행하려면 GPU 형태의 강력한 컴퓨팅 머신이 필요합니다.

인프라 구축, 유지 관리 및 최적화에는 많은 비용이 듭니다. TextCortex

당사는 "ms" 단위의 응답 시간이 중요한 사용자 대면 제품을 위해 모델을 축소하고 마진 동인인 비용 최적화를 수행해 온 이 분야의 전문가입니다.

1) 토큰당 지불

소규모 운영에 이상적 소규모 운영에는 두 가지 비용 절감 방식으로 네오코텍스 시스템의 이점을 누릴 수 있습니다. 예를 들어, 한 달에 10만 건 미만의 요청 또는 100억 미만의 매개변수를 가진 소규모 모델.

다른 고객과 공유 환경에서 실행합니다.

2) GPU 시간당 지불

대규모 프로세스 운영에 이상적입니다. 예를 들어, 수백만 건의 요청 또는 200억 개 이상의 파라미터가 있는 모델

모델이 실행하는 고정 활성 GPU 시간당 요금에 따라 모델 관리 및 호스팅 비용을 지불합니다.

귀하의 사례만을 위한 전용 리소스를 실행하는 우선 순위 옵션입니다.

자세한 안내가 필요한 경우 통합 팀에 문의하세요.