Contenuto creativo API del web

Sia che siate un'azienda di software che vuole adottare un vero valore aggiunto per i propri utenti finali, sia che abbiate bisogno di classificare e generare testi su larga scala.

Siete pronti a raddoppiare la produttività del vostro flusso di lavoro con la potenza dei modelli linguistici di grandi dimensioni? Senza dover affrontare i problemi di infrastruttura?

Rendete il vostro flusso di lavoro intelligente con l'elaborazione del linguaggio naturale, la generazione e la creatività automatica.

Nessun problema di ambiente, nessuna carenza di GPU, nessun problema di prompting, nessun server sovraccarico, nessuna ottimizzazione dei parametri.

Solo pura potenza NLP per i vostri flussi di lavoro e prodotti. Così potete concentrarvi sul prodotto che volete realizzare.

Ogni soluzione è una semplice integrazione di un endpoint API nella vostra base di codice.

Ti aiutiamo a trovare il modello di prezzo più adatto alla tua attività

SCEGLI IL TUO MODELLO

Sono tanti i modelli e tutti sembrano avere un proprio carattere. Vi aiutiamo a scegliere i modelli migliori per il vostro flusso di lavoro. All'interno del sistema NeoCortex ci sono 4 categorie.

Dove Velox sono i modelli più veloci e Alta quelli più potenti. I modelli Sophos sono i nostri modelli esperti NeoCortex perfezionati per flussi di lavoro altamente specializzati.

Questi modelli possono essere utilizzati per una varietà di scopi, tra cui la classificazione, l'estrazione di entità, la sintesi, la generazione di contenuti, la generazione di codici, la parafrasi e molto altro.

Velox

Aecus

Alta

Sophos

Descrizione breve

il veloce

l'equilibrio

il forte

l'esperto

Prezzo per 1K gettoni

$0.01

$0.02

$0.04

$0.12

Supplemento multilingue

(Prezzo per 1K gettoni)

+$0.12

+$0.12

+$0.12

+$0.12

Regolazione fine

su richiesta

su richiesta

su richiesta

su richiesta

GPU dedicate

su richiesta

su richiesta

su richiesta

su richiesta

Parametro Dimensione

Fino a 5 miliardi

Fino a 19 miliardi

Oltre 20 miliardi

-

Got data? Let’s bring your models to the next level

FINE-TUNING - IMPROVE PERFORMANCE AND EFFICIENCY

Out of the box models are not made for your specific pain points?

That’s why we help you nail them down to what you need. With fine-tuned models on your data and workflow we can achieve better results while reducing overall costs in a number of tasks.

A small set of 100 examples can:

- improve task performance by 10x

- lead to 28% cost reduction

.png)

Portate il vostro modello

Sei arrivato alla fine del percorso di ottimizzazione?

Non riesci a inserire un modello più grande nella tua infrastruttura. Ti aiutiamo a ospitare il tuo modello e a gestire l'ottimizzazione in corso.

- Elimina il 70% del lavoro di creazione di un testo

- Personalizzazione della generazione di testo in base agli utenti, al settore e alla nicchia di appartenenza

- Aggiungete un imbattibile risparmio di tempo alla vostra proposta di valore

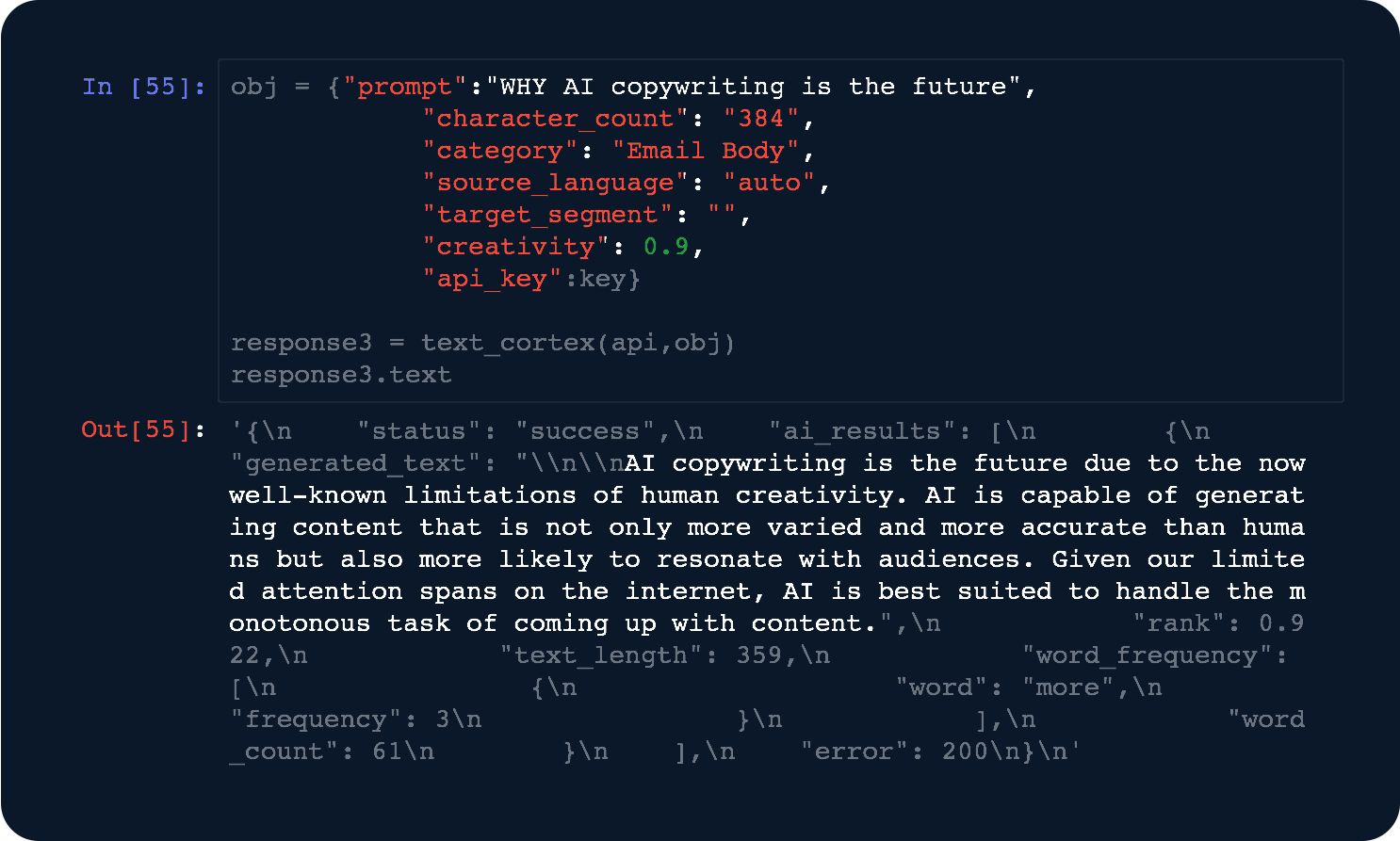

API potenti e facili da usare

SVILUPPATORI A CUORE

Da sviluppatori per sviluppatori. Integrati al nostro API in meno di 3 righe di codice.

- Ottimizzazioni avanzate - Modifichiamo costantemente i modelli per ottenere le migliori velocità di risposta.

- Calcoli dedicati - Sbloccate prestazioni più elevate con la potenza di calcolo dedicata.

Rendere il flusso di lavoro intelligente

Stai cercando un servizio per ospitare il tuo modello linguistico di grandi dimensioni su API? Stai lottando per creare un modello più grande sulla tua infrastruttura?

Ti aiutiamo a ospitare il tuo modello e a occuparti dell'ottimizzazione continua.

Riscrittura del testo API

Date al vostro flusso di lavoro o ai vostri utenti il potere di riscrivere qualsiasi cosa.

Riassunto del testo API

Riassumere qualsiasi cosa nel flusso di lavoro per facilitarne la digestione.

Generazione di testo API

Creare contenuti per articoli lunghi, e-mail e post sui social media.

Generazione visiva API

Utilizzate la Diffusione stabile per creare bozze visive nel vostro flusso di lavoro.

Alcune delle domande più frequenti

Il termine "token" indica il volume di lavoro dei nostri modelli. Dall'input che gli date per lavorare all'output che generano per voi.

Pensate a loro come al pagamento dei litri d'acqua che consumate dal vostro sistema cittadino e che scaricate di nuovo in esso.

I token sono una forma di misura che può essere espressa in unità diverse, come 1 litro d'acqua è uguale a 1000 millilitri d'acqua. Allo stesso modo, 1 gettone è composto da 4 caratteri.

BTW, sapevate che una parola media è composta da 4,5 caratteri? Quindi 1 token è quasi una parola!

Per mettere tutto questo in prospettiva. Il testo fino a qui ha circa 670 caratteri, 124 parole e circa 169 token.

Se Alta avesse creato questo blocco sarebbe costato:

[numero di token totali] x [prezzo per token di Alta] = costo

169 x 0,00002 = 0,0038 USD

Lavoriamo per la maggior parte del tempo con i nostri modelli proprietari NeoCortex.

Altri modelli che possiamo ospitare, ottimizzare e gestire per voi includono:

- GPT Neo 2,7 mld.

- GPT-J 6 mld.

- GPT NeoX 20 mld.

- OPT: Open Pre-trained Transformer Language Models (da 125M a 66 bn)

- FairSeq (13 bn.)

- CodeGen (16 bn.)

- Bloom 560m

- Bloom 1,1 bn.

- Bloom 1,7 bn.

- Bloom 3 bn.

- Bloom 7,1 bn.

- Bloom 176 bn. (presto disponibile)

- t5 Small

- t5 Base

- t5 Large

- t5 3b

- t5 11b

- Stable Diffusion hosted API

In caso di ulteriori domande, contattate il nostro team di integrazione.

Calcoliamo le spese in base alla quantità di token di input e output con cui si lavora.

Un'attività di generazione con il nostro modello "Aecus" per LongForm è il più delle volte molto pesante in termini di output.

Pensate alla seguente richiesta di input:

"La generazione di testo NeoCortex API vi aiuta nel vostro flusso di lavoro" (60 caratteri = 15 token)

Ecco l'output effettivo:

"Cos'è NeoCortex?

NeoCortex è una generazione di testo ad apprendimento profondo API che usa solo il linguaggio naturale per generare testi. Il testo generato è progettato per essere leggibile e comprensibile per l'utente, aiutandolo nel suo flusso di lavoro. API è facile da imparare, con un'interfaccia semplice. Questo lo rende perfetto per l'uso da parte degli sviluppatori che vogliono creare le proprie applicazioni". (360 caratteri = 90 gettoni)

Il conteggio totale dei gettoni è di 15 + 90 = 105 gettoni.

Per la richiesta verranno addebitati 0,02 $ divisi per 1000 volte 105 = 0,0021 $.

Sì.

Quando si iscriversi alla nostra piattaforma e generare una chiave si hanno automaticamente 5 dollari per provare le nostre API. alla nostra piattaforma e si genera una chiave API si hanno automaticamente 5 dollari per provare le nostre API per 30 giorni.

Per assistenza sulla vostra integrazione contattate il nostro team di integrazione.

Quando mettiamo a punto i vostri modelli, prendiamo i vostri dati e insegniamo a un modello come comportarsi su di essi e cosa ci si aspetta.

Come un bell'abito, stiamo confezionando un modello per la generazione, la classificazione e l'estrazione del testo in base alle vostre esigenze.

Tutto ciò di cui abbiamo bisogno è un set di dati di alta qualità provenienti dal vostro flusso di lavoro.

Abbiamo riscontrato i primi miglioramenti a partire da set di dati di appena 500 osservazioni.

In caso di ulteriori domande, contattate il nostro team di integrazione.

Sì.

Le funzionalità di base richiedono meno di 3 righe di codice. Per questo motivo disponiamo anche di diversi pacchetti OSS per una facile integrazione(PyPi, NPM-JS).

Inoltre, offriamo un supporto dedicato all'integrazione per il tempo di onboarding.

Mentre i nuovi arrivati hanno bisogno di circa 4-6 settimane per vedere i primi risultati. Chi passa alla nostra infrastruttura si orienta in meno di 2 settimane.

Cerchiamo di gestire gli endpoint di API nel modo più semplice possibile. Siamo sempre felici di aiutarvi a trovare il modello migliore.

Se cercate una guida diretta, contattate il nostro team di integrazione.

L'esecuzione di modelli linguistici di grandi dimensioni (LLM) richiede potenti macchine di calcolo sotto forma di GPU.

Costruire l'infrastruttura, mantenerla e ottimizzarla comporta costi elevati. Siamo esperti in questo, avendo ridimensionato i nostri modelli per i nostri prodotti rivolti agli utenti, dove i tempi di risposta in "ms" sono importanti e l'ottimizzazione dei costi è il nostro fattore di margine.

Con TextCortex avete il vantaggio di beneficiare del nostro sistema NeoCortex in due modi per risparmiare sui costi:

1) Pay-per-token

Ideale per le operazioni su scala ridotta. Ad esempio, meno di 100.000 richieste al mese o modelli più piccoli con meno di 10 miliardi di parametri.

Si opera in un ambiente condiviso con altri clienti.

2) Pay-per-GPU-hour

Ideale per operazioni di processo su larga scala. Per esempio, milioni di richieste o modelli con più di 20 miliardi di parametri.

Il cliente paga per la gestione e l'hosting dei modelli in base a una tariffa oraria fissa per GPU attiva.

Si tratta di un'opzione prioritaria che prevede l'utilizzo di risorse dedicate solo per il proprio caso.

Se desiderate ulteriori indicazioni, contattate il nostro team di integrazione.

Copilota AI per la tua conoscenza.

Collega le tue conoscenze e lavora con i tuoi dati.