Contenido creativo API de la web

Tanto si se trata de una empresa de software que quiere adoptar un verdadero valor añadido para sus usuarios finales, como si necesita clasificar y generar textos a gran escala.

¿Está preparado para multiplicar por 4 la productividad de su flujo de trabajo con la potencia de los grandes modelos lingüísticos? ¿Sin todo el dolor de la infraestructura?

Haga que su flujo de trabajo sea inteligente con el procesamiento del lenguaje natural, la generación y la creatividad de las máquinas.

Sin problemas de entorno, sin escasez de GPU, sin problemas de avisos, sin servidores sobrecargados, sin optimización de parámetros.

Sólo pura potencia NLP para sus flujos de trabajo y productos. Para que puedas centrarte en el producto que quieres sacar.

Cada solución es una simple integración de un punto final de API en su código base.

Te ayudamos a encontrar el modelo de precios adecuado para tu tarea

ELIGE TU MODELO

Hay tantos modelos y todos tienen su propio carácter. Le ayudamos a elegir los mejores modelos de trabajo para su flujo de trabajo. Dentro del sistema NeoCortex hay 4 categorías.

Donde Velox son los modelos más rápidos y Alta son los más potentes. Los modelos Sophos son nuestros modelos expertos de NeoCortex perfeccionados para flujos de trabajo altamente especializados.

Estos modelos pueden utilizarse para una gran variedad de propósitos, como la clasificación, la extracción de entidades, el resumen, la generación de contenidos, la generación de códigos, la paráfrasis y mucho más.

Velox

Aecus

Alta

Sophos

Breve descripción

el ayuno

la equilibrada

el fuerte

el experto

Precio por 1K fichas

$0.01

$0.02

$0.04

$0.12

Recargo multilingüe

(Precio por 1.000 fichas)

+$0.12

+$0.12

+$0.12

+$0.12

Ajuste fino

a petición

a petición

a petición

a petición

GPUs dedicadas

a petición

a petición

a petición

a petición

Parámetro Tamaño

Hasta 5.000 millones

Hasta 19.000 millones

Más de 20.000 millones

-

Got data? Let’s bring your models to the next level

FINE-TUNING - IMPROVE PERFORMANCE AND EFFICIENCY

Out of the box models are not made for your specific pain points?

That’s why we help you nail them down to what you need. With fine-tuned models on your data and workflow we can achieve better results while reducing overall costs in a number of tasks.

A small set of 100 examples can:

- improve task performance by 10x

- lead to 28% cost reduction

.png)

Traiga su propio modelo

¿Has llegado al final del camino con tu optimización?

No consigues poner un modelo mayor en tu infraestructura. Te ayudamos a alojar tu propio modelo y a ocuparte de la optimización en curso.

- Elimina el 70% del trabajo de creación de textos

- Personalice la generación de texto para que se adapte a sus usuarios, a su sector y a su nicho de mercado

- Añada un ahorro de tiempo insuperable a su propuesta de valor

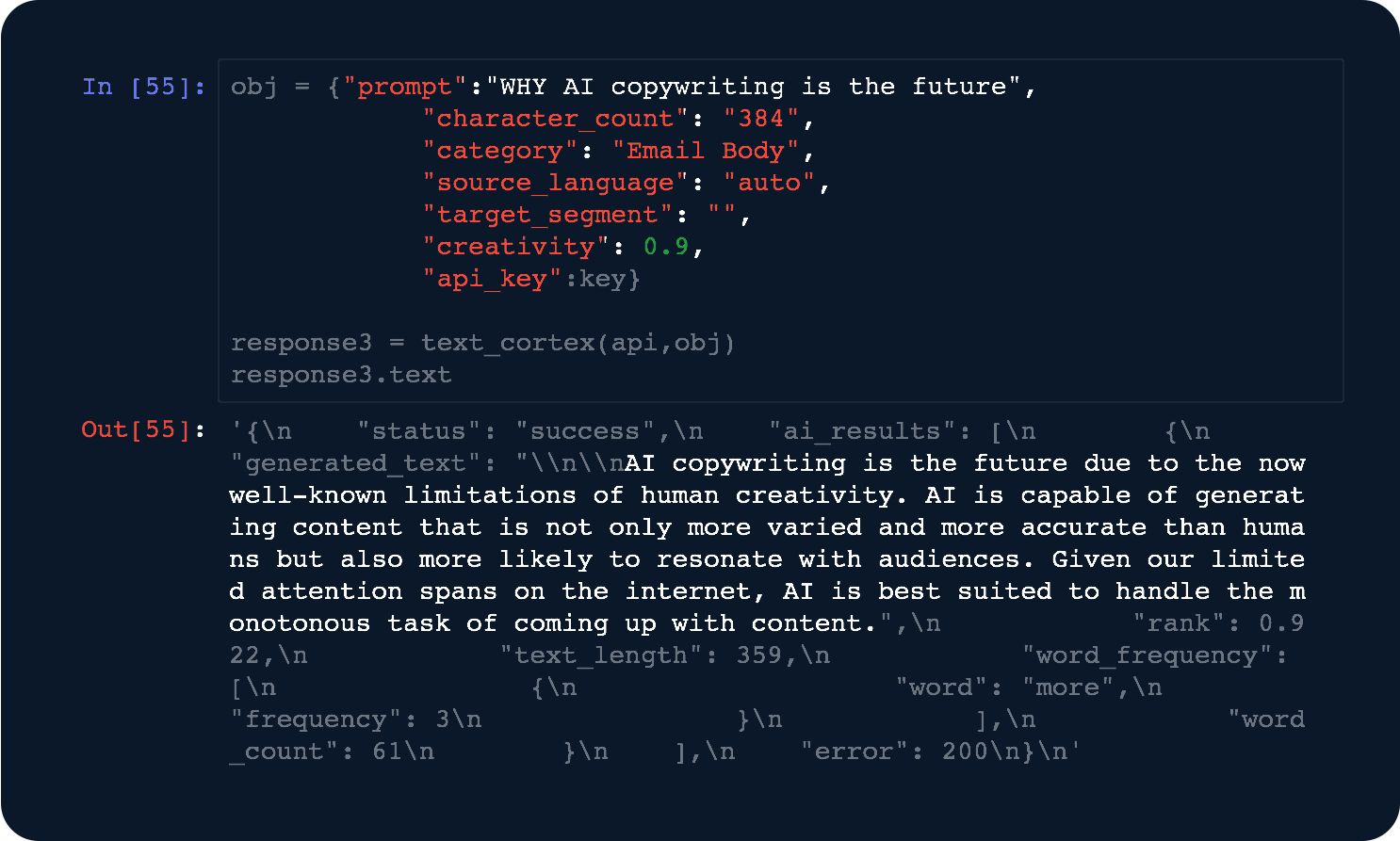

APIs potentes y fáciles de usar

DESARROLLADORES DE CORAZÓN

De Desarrolladores para Desarrolladores. Intégrate en nuestro API en menos de 3 líneas de código.

- Optimizaciones avanzadas: ajustamos constantemente los modelos para conseguir las mejores velocidades de respuesta.

- Cálculos dedicados: desbloquee un mayor rendimiento con la potencia de cálculo dedicada.

Haga que su flujo de trabajo sea inteligente

¿Buscas un servicio para alojar tu gran modelo lingüístico como API? ¿Te cuesta hacer un modelo más grande en tu infraestructura?

Te ayudamos a alojar tu propio modelo y a ocuparte de la optimización continua.

Reescritura de textos API

Dé a su flujo de trabajo o a sus usuarios el poder de reescribir cualquier cosa.

Resumir textos API

Resume todo lo que hay en tu flujo de trabajo para que sea más fácil de digerir.

Generación de texto API

Cree contenidos para artículos largos, correos electrónicos y publicaciones en las redes sociales.

Generación visual API

Utilice la difusión estable para crear borradores visuales en su flujo de trabajo.

Algunas de las preguntas más frecuentes

Un token es el término de la industria para el volumen de nuestros modelos. Desde la entrada que les das para trabajar hasta la salida que generan para ti.

Piensa en ellos como si pagaras por los litros de agua que consumes de la red de tu ciudad y los devuelves a ella.

Las fichas son una forma de medida que puede expresarse en diferentes unidades, como 1 litro de agua es lo mismo que 1000 mililitros de agua. Del mismo modo, 1 ficha consta de 4 caracteres.

¿Sabías que una palabra media tiene 4,5 caracteres? Así que 1 ficha es casi una palabra.

Para poner todo esto en perspectiva de nuevo. El texto hasta aquí tiene unos 670 caracteres, 124 palabras y hace aproximadamente 169 tokens.

Si Alta hubiera creado este bloque habría costado:

[# de tokens totales] x [precio por token de Alta] = coste

169 x 0,00002 = 0,0038 USD

Trabajamos la mayor parte del tiempo con nuestros propios modelos NeoCortex.

Otros modelos que podemos alojar, optimizar y explotar para usted son:

- GPT Neo 2.7 bn.

- GPT-J 6 bn.

- GPT NeoX 20 bn.

- OPT: Open Pre-trained Transformer Language Models (125M a 66 bn)

- FairSeq (13 bn.)

- CodeGen (16 bn.)

- Bloom 560m

- Bloom 1.1 bn.

- Bloom 1,7 bn.

- Bloom 3 bn.

- Bloom 7,1 bn.

- Bloom 176 bn. (disponible en breve)

- t5 Small

- t5 Base

- t5 Large

- t5 3b

- t5 11b

- Stable Diffusion hosted API

En caso de que tenga más preguntas, póngase en contacto con nuestro equipo de integración .

Calculamos los cargos en función de la cantidad de tokens de entrada y salida con los que se trabaja.

Una tarea de generación con nuestro modelo "Aecus" para LongForm es, la mayoría de las veces, muy pesada en cuanto a la salida.

Piense en la siguiente solicitud de entrada:

"La generación de texto NeoCortex API le ayuda en su flujo de trabajo" (60 caracteres = 15 tokens)

Aquí está la salida real:

"¿Qué es el NeoCortex?

NeoCortex es una generación de texto de aprendizaje profundo API, que utiliza sólo el lenguaje natural para generar textos. El texto generado está diseñado para ser legible y comprensible por humanos, ayudándole en su flujo de trabajo. API es fácil de aprender, con una interfaz sencilla. Esto lo hace perfecto para que lo utilicen los desarrolladores que quieran crear sus propias aplicaciones." (360 caracteres = 90 tokens)

Hace un recuento total de tokens de 15 + 90 = 105 tokens.

Se cobraría 0,02 $ dividido por 1000 veces 105 = 0,0021 $ por su solicitud.

Sí.

Cuando te registras a nuestra plataforma y generas una clave API dispones automáticamente de 5 $ para probar nuestras API durante 30 días.

Si necesitas ayuda sobre tu integración, ponte en contacto con nuestro equipo de integración.

Cuando afinamos sus modelos, estamos tomando sus datos y enseñando a un modelo cómo comportarse con ellos y qué se espera de ellos.

Al igual que un buen traje, le hacemos un modelo de generación, clasificación y extracción de texto a la medida de sus necesidades.

Todo lo que necesitamos de usted es un conjunto de datos de alta calidad de su flujo de trabajo.

Vemos las primeras mejoras a partir de conjuntos de datos tan pequeños como 500 observaciones.

Si tiene más preguntas, póngase en contacto con nuestro equipo de integración.

Sí.

Las funcionalidades de la base requieren menos de 3 líneas de código. Para ello disponemos de múltiples paquetes OSS para una fácil integración(PyPi, NPM-JS).

Además, le ofrecemos un soporte de integración dedicado para su tiempo de incorporación.

Mientras que los recién llegados requieren alrededor de 4 a 6 semanas para ver los primeros resultados. Alguien que se cambia a nuestra infraestructura encuentra su camino en menos de 2 semanas.

Aunque intentamos gestionar nuestros puntos finales de API de la forma más autoexplicativa posible. Siempre estamos dispuestos a ayudarle a encontrar el mejor modelo.

Si necesita asesoramiento directo, póngase en contacto con nuestro equipo de integración.

La ejecución de grandes modelos lingüísticos (LLM) requiere una potente maquinaria de cálculo en forma de GPU.

Construir la infraestructura, mantenerla y optimizarla tiene un coste elevado. Somos expertos en este campo, ya que hemos reducido la escala de nuestros modelos para nuestros productos de cara al usuario, en los que los tiempos de respuesta en "ms" son importantes y la optimización de costes es nuestro motor de márgenes.

Con TextCortex tiene la ventaja de beneficiarse de nuestro sistema NeoCortex de dos formas que ahorran costes:

1) Pago por token

Ideal para operaciones a pequeña escala. Por ejemplo, menos de 100.000 solicitudes al mes o modelos más pequeños con menos de 10.000 millones de parámetros.

Se ejecuta en un entorno compartido con otros clientes.

2) Pago por GPU-hora

Ideal para operaciones a gran escala. Por ejemplo, millones de solicitudes o modelos con más de 20.000 millones de parámetros.

Usted nos paga por gestionar y alojar los modelos en función de la tarifa plana por hora de GPU activa que ejecuten sus modelos.

Se trata de una opción prioritaria en la que dispones de recursos dedicados sólo para tu caso.

Si necesita más información, póngase en contacto con nuestro equipo de integración.

Copiloto de IA para tu conocimiento.

Conecta tus conocimientos y trabaja con tus propios datos.